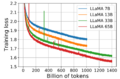

(Llama 모델의 각 모델별 모델의 크기별 훈련 손실 감소 그래프 [https://arxiv.org/abs/2302.13971 LLaMA: Open and Efficient Foundation Language Models] 논문 중 일부<ref name="touvron2023llama">{{Cite journal | author = Hugo Touvron, Thibaut Lavril, Gautier Izacard, Xavier Martinet, Marie-Anne Lachaux, Timothée Lacroix, Baptiste Rozière, Naman Goyal, Eric Hambro, Faisal Azhar, Aurelien Rodriguez, Armand Joulin, Edouard Grave, Guillaume Lample | title = LLaMA: Open and Efficient Foundation Language Models | year = 2023 |...) |

(차이 없음)

|

2024년 4월 22일 (월) 16:03 기준 최신판

파일 역사

날짜/시간 링크를 클릭하면 해당 시간의 파일을 볼 수 있습니다.

| 날짜/시간 | 섬네일 | 크기 | 사용자 | 설명 | |

|---|---|---|---|---|---|

| 현재 | 2024년 4월 22일 (월) 16:03 |  | 1,487 × 980 (142 KB) | Gaon12 (토론 / 기여) | Llama 모델의 각 모델별 모델의 크기별 훈련 손실 감소 그래프 [https://arxiv.org/abs/2302.13971 LLaMA: Open and Efficient Foundation Language Models] 논문 중 일부<ref name="touvron2023llama">{{Cite journal | author = Hugo Touvron, Thibaut Lavril, Gautier Izacard, Xavier Martinet, Marie-Anne Lachaux, Timothée Lacroix, Baptiste Rozière, Naman Goyal, Eric Hambro, Faisal Azhar, Aurelien Rodriguez, Armand Joulin, Edouard Grave, Guillaume Lample | title = LLaMA: Open and Efficient Foundation Language Models | year = 2023 |... |

이 파일을 덮어쓸 수 없습니다.

이 파일을 사용하는 문서

다음 문서 1개가 이 파일을 사용하고 있습니다:

The hash calculation took too much time or memory and stopped. 해시 계산에 너무 많은 시간이나 메모리가 소요되어 중단했습니다.